Computer Vision & CNC-Prozessautomatisierung

Object Pose Estimation for CNC Machining Processes

Ein industrielles Vision-System zur Erkennung von Bauteilen und zur 6D-Lagebestimmung auf Basis von RGB-D-Daten, korrigierter Punktwolke, YOLO-Erkennung und FoundationPose.

Projektüberblick

Vom Kamerabild zur nutzbaren Bauteilpose

Das Projekt verbindet Objekterkennung, Kamerakalibrierung, Punktwolkenkorrektur und CAD-basierte Pose-Schätzung zu einem technischen Workflow für Bearbeitungs- und Automatisierungsprozesse.

Intensitätsbild, Tiefenbild und Kameraparameter als Basis für die Geometrie.

Lokalisierung des Bauteils, Klassenzuordnung und ROI für die Pose-Schätzung.

STL-Modelle werden mit den korrigierten RGB-D-Daten zur 6D-Pose verbunden.

Mehransichten können die Pose weiter verfeinern und Messabweichungen reduzieren.

Pipeline

Die Korrektur der Geometrie kommt vor FoundationPose

FoundationPose arbeitet auf den RGB-D- und Punktwolkendaten. Deshalb wird die Kamera- und Tiefengeometrie zuerst sauber vorbereitet, bevor die Pose berechnet wird.

-

01

RGB-D-Aufnahme

Die Kamera liefert Intensität, Tiefe und intrinsische Parameter.

-

02

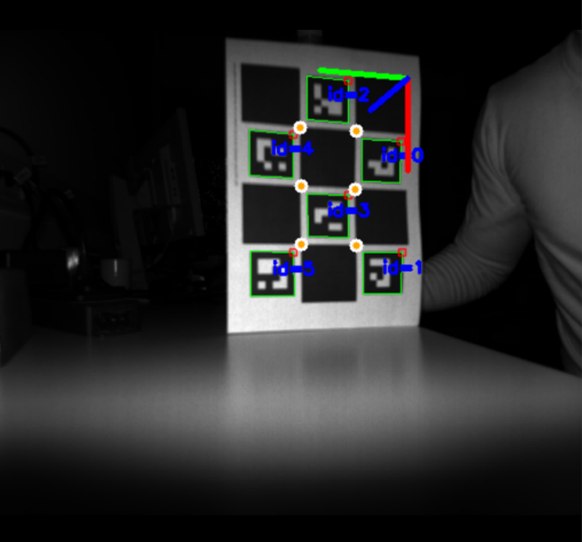

Kalibrierung

ChArUco- und Hand-Eye-Daten verbinden Kamera, Werkzeug und Koordinatensysteme.

-

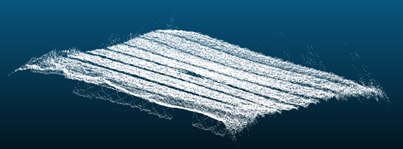

03

Punktwolke korrigieren

Fisheye- und Tiefenabweichungen werden vor der Pose-Schätzung bereinigt.

-

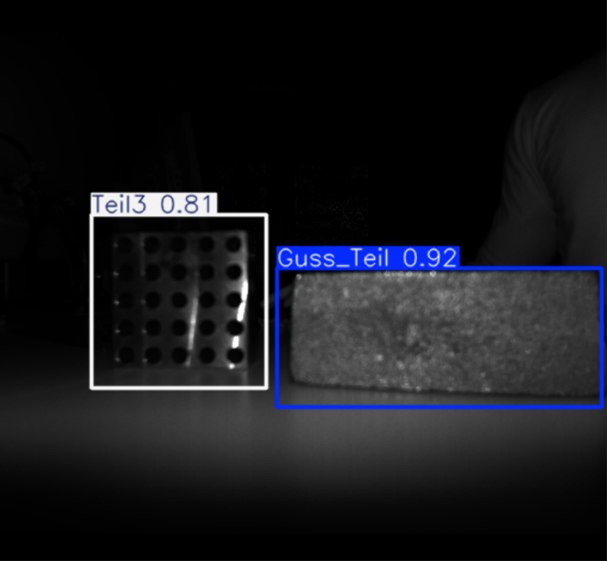

04

YOLO Detection

Das Bauteil wird erkannt, klassifiziert und als ROI an die Pose-Stufe weitergegeben.

-

05

FoundationPose

Das passende CAD-Modell wird mit der korrigierten RGB-D-Geometrie abgeglichen.

-

06

Pose Output

Die Ausgabe ist eine 6D-Pose mit Translation, Rotation und optionaler ICP-Verfeinerung.

01 / Kalibrierung

Kamera, Werkzeug und Koordinaten vorbereiten

Die Kalibrierung ist die Grundlage dafür, dass Bilddaten, Tiefendaten, Roboterpose und Bauteilgeometrie im gleichen technischen Zusammenhang ausgewertet werden können.

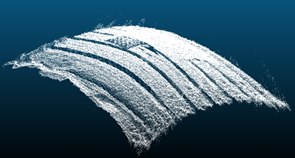

02 / Geometrie

Punktwolkenkorrektur vor der Pose-Schätzung

Vor FoundationPose werden Tiefenbild und Punktwolke korrigiert. Dadurch sieht der Algorithmus die Bauteilgeometrie in einer stabileren Form und arbeitet nicht auf verzerrten Rohdaten.

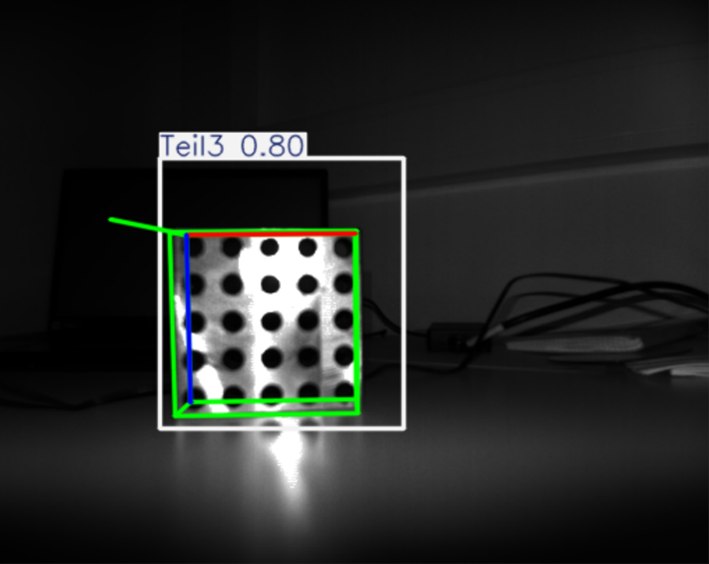

03 / Detection

YOLO liefert Klasse und ROI

YOLO übernimmt die schnelle Objekterkennung. Die erkannte Klasse entscheidet, welches CAD-Modell verwendet wird; die Bounding Box begrenzt den Bereich für die anschließende Pose-Schätzung.

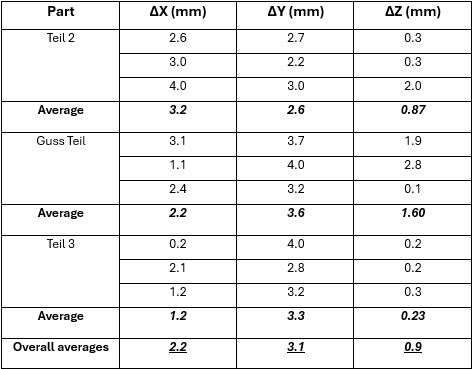

04 / Pose Estimation

FoundationPose auf korrigierter RGB-D-Geometrie

FoundationPose nutzt die korrigierte Geometrie und das passende CAD-Modell, um die 6D-Pose des Bauteils zu bestimmen. Die Ausgabe kann anschließend für Bearbeitung, Prüfung oder robotische Weiterverarbeitung genutzt werden.

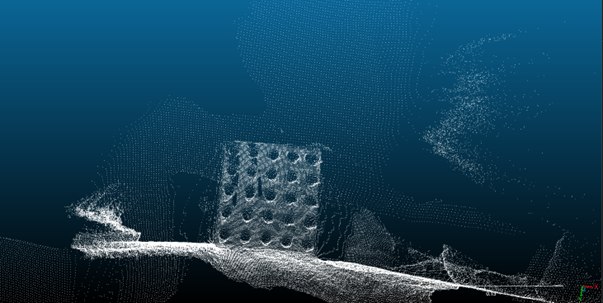

05 / Integration

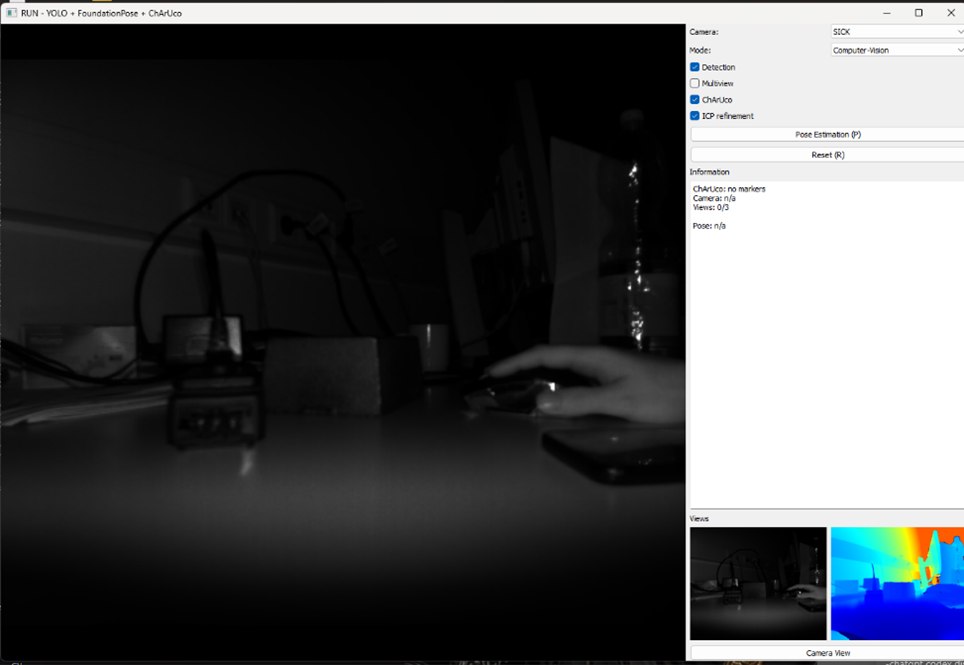

Software-Pipeline für Tests und Auswertung

Die Software verbindet Kameraeingang, YOLO-Modell, CAD-Daten, FoundationPose, Punktwolkenansicht und Ergebnisvisualisierung. Dadurch konnte der gesamte Prozess iterativ getestet und verbessert werden.